Platform chatbot Character.AI batasi chat untuk pengguna yang masih di bawah umur. Langkah signifikan ini diambil untuk mendukung kebijakan Character.AI terbaru yang berfokus pada perlindungan pengguna muda. Pengumuman ini datang setelah meningkatnya tekanan hukum dan regulasi, menandai perubahan besar dalam cara platform chatbot AI populer ini berinteraksi dengan basis penggunanya.

Berdasarkan informasi yang dilaporkan oleh The Verge, layanan Character.AI meluncurkan sistem internal yang disebut “model jaminan usia” (Age Assurance Model) untuk mendukung penerapan kebijakan tersebut. Model ini dirancang untuk mengklasifikasikan usia pengguna berdasarkan beberapa faktor, termasuk tipe karakter AI yang mereka ajak bicara, yang kemudian dikombinasikan dengan data pihak ketiga atau data internal dari situs tersebut.

Model Jaminan Usia Character.AI: Cara Kerja Pembatasan

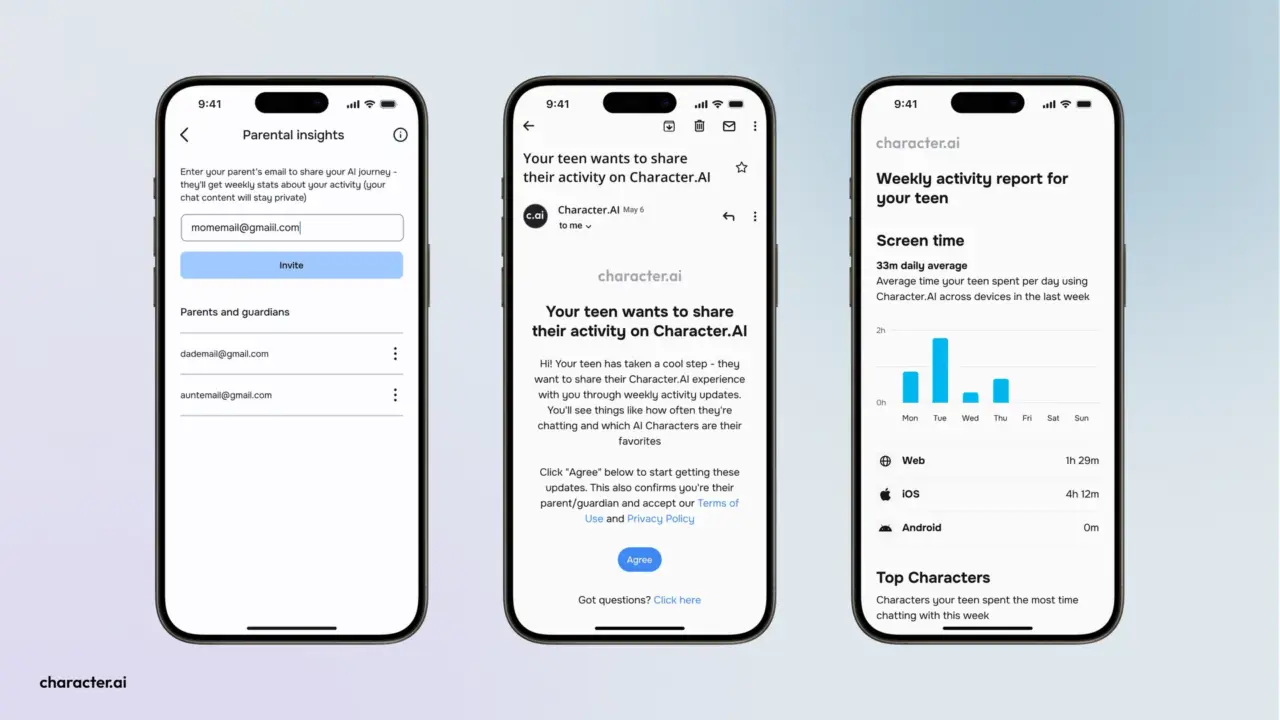

Pengguna baru maupun lama akan melewati proses identifikasi melalui model jaminan usia ini. Jika seorang pengguna terdeteksi sebagai individu berusia di bawah 18 tahun, mereka akan secara otomatis dialihkan ke versi aplikasi yang dirancang khusus agar aman untuk remaja. Proses pengalihan ini akan berlaku hingga batas waktu yang ditentukan, yaitu 25 November.

Untuk pengguna dewasa yang mungkin keliru diidentifikasi sebagai minor, perusahaan menyediakan solusi verifikasi. Opsi ini dapat diakses melalui Persona, sebuah situs pihak ketiga, yang memerlukan data sensitif seperti kartu identitas asli pemiliknya. Ini memastikan bahwa pengguna yang memenuhi syarat dapat mengakses versi penuh dari layanan Character.AI.

Implikasi Kebijakan Character.AI: Pembatasan Waktu dan Larangan Penuh

Dengan adanya aturan baru ini, Character.AI pengguna minor akan menghadapi pembatasan signifikan. Remaja hanya akan diizinkan untuk berinteraksi dengan karakter AI selama dua jam per hari. Pembatasan durasi ini akan semakin menyusut hingga menjadi larangan penuh yang akan mulai berlaku efektif pada tanggal 25 November. Ini merupakan salah satu bagian penting dari kebijakan Character.AI yang baru.

Karandeep Anand, selaku CEO Character.AI, menyatakan bahwa langkah ini adalah tindakan yang “sangat, sangat berani”. Beliau menambahkan bahwa pihak perusahaan berusaha mencari jalan tengah di tengah meningkatnya tekanan hukum dan regulasi dari berbagai pemerintah. Keputusan ini menunjukkan komitmen Character.AI untuk mematuhi standar keamanan dan etika yang berlaku, terutama terkait perlindungan anak di bawah umur.

Tuntutan Hukum dan Tekanan Regulasi di Balik Kebijakan Character.AI

Sebelum implementasi kebijakan Character.AI ini, platform tersebut telah menghadapi berbagai tuntutan hukum. Tuntutan ini berkaitan dengan dugaan kelalaian dan praktik dagang yang menipu, yang diajukan oleh orang tua. Mereka mengklaim bahwa anak-anak mereka terlibat dalam hubungan yang tidak pantas atau berbahaya dengan chatbot AI.

Situasi ini semakin diperparah dengan usulan RUU federal di Amerika Serikat yang bertujuan untuk melarang penyediaan pendamping Artificial Intelligence (AI) untuk anak di bawah umur. Anand mencatat bahwa kurang dari 10 persen dari total basis pengguna perusahaan melaporkan diri berusia di bawah 18 tahun. Meskipun demikian, perusahaan tetap berkomitmen untuk menerapkan batasan guna melindungi sebagian kecil penggunanya yang rentan.

Langkah Character.AI batasi chat merupakan respons proaktif terhadap lingkungan regulasi yang semakin ketat dan kekhawatiran masyarakat mengenai interaksi antara anak-anak dan teknologi AI. Ini menunjukkan bahwa perusahaan tidak hanya berfokus pada inovasi tetapi juga pada tanggung jawab sosial.

Fitur yang Masih Tersedia bagi Character.AI Pengguna Minor

Meskipun ada larangan untuk melakukan chat, Character.AI pengguna minor masih diizinkan untuk mengakses beberapa fitur penting di situs. Remaja masih dapat meninjau riwayat obrolan lama mereka. Selain itu, mereka juga bisa menggunakan fitur non-obrolan yang meliputi pembuatan karakter, pembuatan video, dan penulisan cerita. Ini memungkinkan mereka untuk tetap terlibat dengan aspek kreatif dan komunitas platform tanpa risiko interaksi yang tidak pantas.

Character.AI juga menyampaikan “permintaan maaf yang mendalam” kepada basis pengguna remajanya. Perusahaan mengakui bahwa sebagian besar dari mereka menggunakan produk “dalam batas aturan konten” yang telah ditetapkan. Hal ini menunjukkan bahwa pembatasan adalah respons terhadap tekanan eksternal dan bukan karena pelanggaran massal dari para pengguna remaja.

Dengan kebijakan Character.AI ini, platform berharap dapat menciptakan lingkungan yang lebih aman bagi semua penggunanya. Tujuan utamanya adalah tetap menawarkan pengalaman interaktif yang inovatif, sekaligus menjaga kepatuhan terhadap regulasi dan ekspektasi keselamatan. Keputusan Character.AI batasi chat ini menjadi preseden penting bagi industri AI.